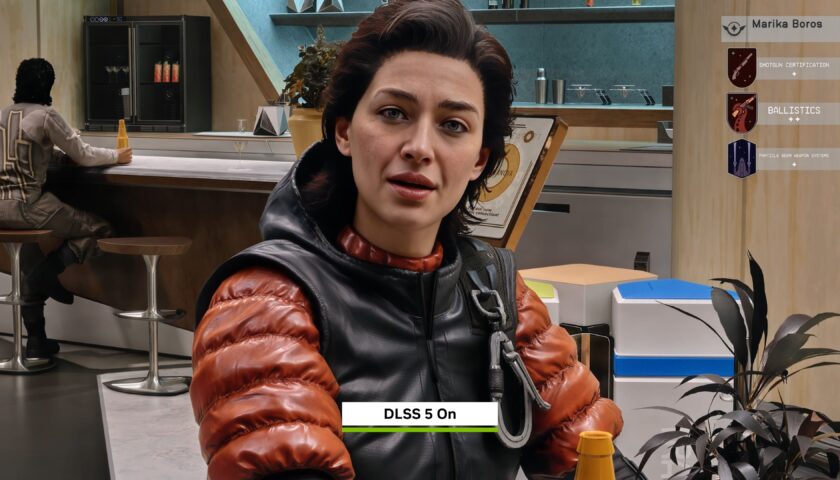

DLSS 5 ist die neueste Iteration der Nvidia‑eigenen DLSS‑Technologie, die auf RTX‑Grafikkarten von Nvidia verfügbar ist. Die Enthüllung wurde insbesondere auf Social Media überwiegend negativ aufgenommen.

Vor allem wurde kritisiert, dass die veränderten Bilder wie „AI Slop“ aussehen und zu stark gängigen KI‑Bildern ähneln, die oft einen homogenen, austauschbaren Look haben. Bei einer Presse-Fragerunde mit Toms Hardware auf der GTC 2026 reagierte Nvidia‑CEO Jensen Huang auf die jüngsten Beschwerden zu DLSS 5.

Zur Kritik sagte er klar und deutlich: „Nun, als Erstes: Sie liegen völlig falsch“. Er betonte, dass Entwickler die KI kontrollieren und feinjustieren können – auch Bethesda antwortete bereits in ähnlicher Form.

Huang ergänzte, es liege an den Entwicklern, wie sie die KI‑Funktionen von DLSS 5 nutzen wollen, und deutete an, dass die Technologie weit mehr könne, als nur Licht und Grafik „aufzuhübschen“. DLSS 5 funktioniere „sehr anders als generative KI“ und sei vielmehr „Content‑Control‑Generative‑AI“.

Entwickler können DLSS 5 anpassen

DLSS 5 soll erst im Herbst erscheinen und wird bis dahin noch angepasst werden. Ein Teil der frühen Kritik an den Vorher‑/Nachher‑Vergleichen richtete sich darauf, dass die Gesichter der Figuren zu stark verändert wurden; einige verwiesen dabei speziell auf Grace aus Resident Evil Requiem. Nicht nur ihr Gesicht wirke wie ein Instagram-Filter, auch ihr Haar hat in der DLSS‑5‑Variante markante dunkle Ansätze, während sie im Original überwiegend blond wirkt.

KI ist für viele Gamer derzeit ein rotes Tuch, nicht nur wegen der gestiegenen Nachfrage nach Hardware für KI‑Rechenzentren, die zu RAM‑ und SSD‑Engpässen und höheren Preisen für Endkunden geführt hat. Dennoch kann DLSS 5 dabei helfen, mit relativ wenig Aufwand ein deutlich besseres grafisches Ergebnis zu erzielen.

Doch auch hier liegt ein Lernprozess, wie Bethesda bereits andeutete. Unter einem Tweet von Digital Foundry schrieb der offizielle Account: „[…] Unsere Grafikteams werden die Beleuchtung und den finalen Effekt noch weiter anpassen, um das bestmögliche Ergebnis für jedes Spiel zu erzielen. Die Anpassungen liegen vollständig in der Hand unserer Künstler und sind für die Spieler völlig optional.“

via Toms Hardware, GameRant, Bildmaterial: Digital Foundry

Ich hab das Thema der bewerteten Menschen nicht aufgemacht, sondern Du. 🤷♂️

Mir kam gerade die Idee im Retro Thread, dass das Hallucinations-Feature von AI bspw. wie in den zahlreichen DLSS 5 Vids gezeigt durchaus interessant sein könnte bei Retro-Games. Als Bsp. was mir da spontan Kid Icarus eingefallen, was ich letztes Jahr angefangen hatte zu spielen. Gutes Upscaling mit Detailenrichment bei den Sprites wäre da ein Experiment wert. Speziell bei jüngeren Gamern, die die alten Spiele nicht kennen. Als Retro Liebhaber kann man wenn man will immer wieder zurück aufs Ursprungsgame.

Tut mir echt total leid, wenn ich Korruption und Massenmord so'n bisschen sketchy finde.

Aber wenn ich die schöne neue KI-Zeit nur dann so richtig genießen kann, wenn ich im billigstmöglichen moralischen Relativismus bade, will ich gerne einen Versuch wagen.

Das gibt es nicht erst seit gestern, normalerweise wird das mit festen Algorithmen gemacht, damit die Konsistenz gewahrt bleibt (ich nutzte gerne den Super2xSaI Filter von Retroarch, inzwischen bin ich wieder bei normalen 2x oder 2xhq angelangt).

Wo es besonders gerne gemacht wird, sind HD-Texturenpacks für bekannte Retro-Videospiele aus den frühen 2000ern. Da werden einfach die alten Texturen genommen, durch eine KI gejagt und angemessen für 4k hochskaliert. Afaik war da Nvidia sogar selbst dabei bei den China-Versionen von Mario Galaxy für Nvidia Shield, aber nagel micht nicht fest, das ist 10 Jahre her.

Das jetzt live hinzubekommen, ähnlich wie NVidia RTX HDR nachträglich HDR-Effekte in diese Spiele bringt, wäre eine coole Idee.

Super2xSaI genau wie bspw. xBRZ , welches ein moderner Algorithmus ist, sind keine KI Upscaler. Sie sind determinstische, regelbasierte Algorithmen, die zwischen benachbarten Pixeln interpolieren. Das ist eine komplett andere Logik und Modelle als bspw. KI Image Upscaler wie ESRGAN, die durch den Input kontinuierlich trainiert werden. Das was Nvidia mit DLSS vorgestellt hat ist noch einmal eine andere Geschichte. Da wird nicht nur das fertig gerenderte Pic lokal nachgebaut sondern auch auch kontextbezogen von Frame zu Frame sowie einige Postprocessing Effekte nachgezogen.